Social-Media-Plattformen werden verstärkt dazu aufgefordert, ihre Sicherheitsbemühungen für Kinder und Jugendliche zu erhöhen. Denn einige Untersuchungen belegen, dass Instagram, TikTok und Co. Minderjährigen schaden könnten.

Kritik an unzureichenden Maßnahmen großer Social-Plattformen im Bereich Child Safety

Die Whistleblowerin Frances Haugen hatte interne Dokumente veröffentlicht, in denen deutlich wurde, dass beispielsweise Instagram schädliche Auswirkungen der App auf junge User billigend in Kauf nahm. Die Folge war, dass sich Meta einer Untersuchung unterziehen musste – genauo wie TikTok im März dieses Jahres. Denn die Social-Media-Konzerne sollen sich bewusst darauf fokussieren, junge Menschen an die eigenen Dienste zu binden – obwohl sogar die von Haugen veröffentlichen internen Meta-Studien die toxischen Folgen der exzessiven Nutzung belegten.

Und auch an anderer Front gibt es berechtigte Kritik an Instagram in einem ähnlichen Kontext: Wegen Verstößen gegen die DSGVO muss Instagram 405 Millionen Euro Strafe zahlen. Die Plattform hatte unter anderem E-Mail-Adressen und Telefonnummern von Kindern im öffentlichen Raum nicht ausreichend geschützt.

Gerade vor diesem Hintergrund ist es essenziell wichtig, dass Social-Plattformen gewährleisten, jüngere User identifizieren zu können – um im nächsten Schritt entsprechende Maßnahmen zu initiieren, die diese schützen müssen. Hierfür testet Instagram derzeit unter anderem ein KI-Tool von Drittanbieter:innen zur Verifizierung des Alters per Gesichts-Scan. Und Instagram beispielsweise gestattet es Personen unter 13 Jahren nicht, sich anzumelden, während Konten für Minderjährige unter 18 Jahren eine eingeschränkte Funktionalität aufweisen. Doch die bisherigen Bemühungen scheinen nicht auszureichen. Das belegt eine Ofcom-Studie, auf die wir in den nähenden Absätzen näher eingehen möchten.

Jugendliche und Kinder können Social-Sperren einfach umgehen

Die von der Aufsichtsbehörde Ofcom in Auftrag gegebenen Studie zeigt, dass Kinder ihr Alter auf Social-Plattformen derzeit einfach höhersetzen können, um die Regeln zu umgehen. Das geht aus einem BBC-Bericht hervor. Die Ofcom-Studie zeigt konkret, dass 32 Prozent der minderjährigen User ein Konto für Erwachsene besitzen, während 47 Prozent der Kinder im Alter von acht bis 15 Jahren ein Alter von 16 Jahren und älter auf Instagram und Co. haben. Weitere 60 Prozent der User unter 13 Jahren, die trotz beispielsweise Instagrams „Verbot“ ein Social-Media-Konto nutzen, haben eigene Accounts.

Social-Nutzung kann schädliche Auswirkungen auf minderjährige User haben

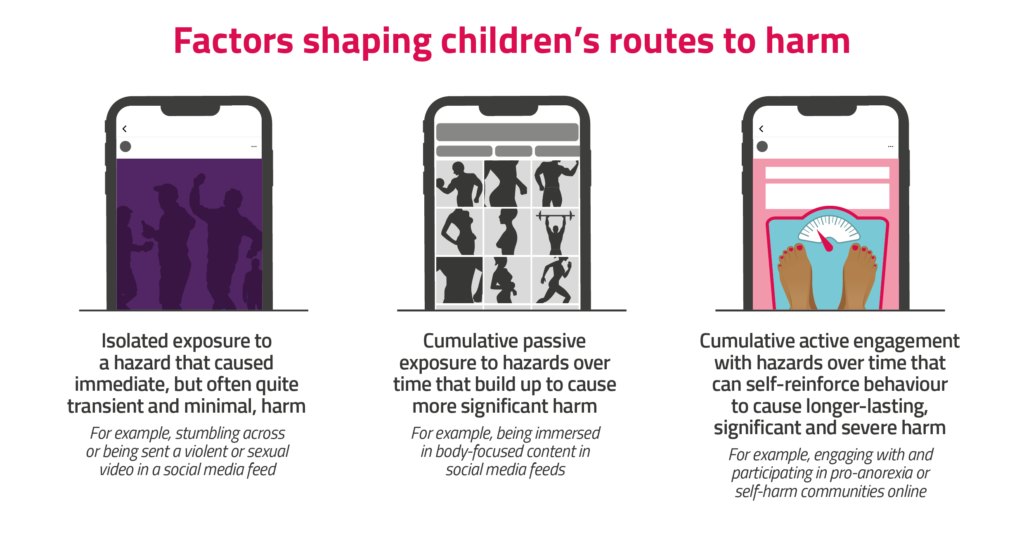

Ofcom erklärt, dass dies das Risiko erhöht, dass Kinder Inhalte sehen, die möglicherweise unangemessen oder schädlich sind.

Anna-Sophie Harling von Ofcom sagte gegenüber BBC News, dass die Art und Weise, wie Social-Media-Plattformen User nach Alter kategorisierten, einen „großen Einfluss“ auf die Inhalte hat, die ihnen gezeigt werden. Weiter erklärt sie, dass die Alterskategorisierungen „eine der wichtigsten Möglichkeiten“ sei, mit denen Plattformen die Sicherheit ihrer User schützen können. Sie betont:

If we want to get serious about protecting children online, we need to make sure that platforms have a way to find out exactly how old those users are. We need to work both with parents and young people, but also platforms, to make sure that the ages at which those accounts are set are done in an accurate way.

YouTube und Meta nehmen Stellung; Twitter und TikTok reagierten bislang nicht

YouTube erklärte, dass die Video-Streaming-Plattform Investitionen zum Schutz von Kindern getätigt hat, etwa die Einführung einer speziellen App für Minderjährige sowie neuer Datenpraktiken für kindgerechte Inhalte. Die BBC bat auch Meta um einen Kommentar. Ein:e Sprecher:in verwies daraufhin auf die neuesten Bemühungen von Meta zur Überprüfung des Alters jüngerer Benutzer:innen, auf die in diesem Artikel bereits hingewiesen wurden. Twitter und TikTok wurden ebenfalls um Kommentare gebeten.

Zur Studie

Die Studie umfasste sechs der führenden Plattformen – Facebook, Instagram, TikTok, Snapchat, Twitter und YouTube –, die alle eine Altersgrenze von 13 Jahren haben. Sie basiert auf Untersuchungen die im Raum Großbritannien durchgeführt wurden. Mehr über die Ofcom-Untersuchung erfährst du hier.